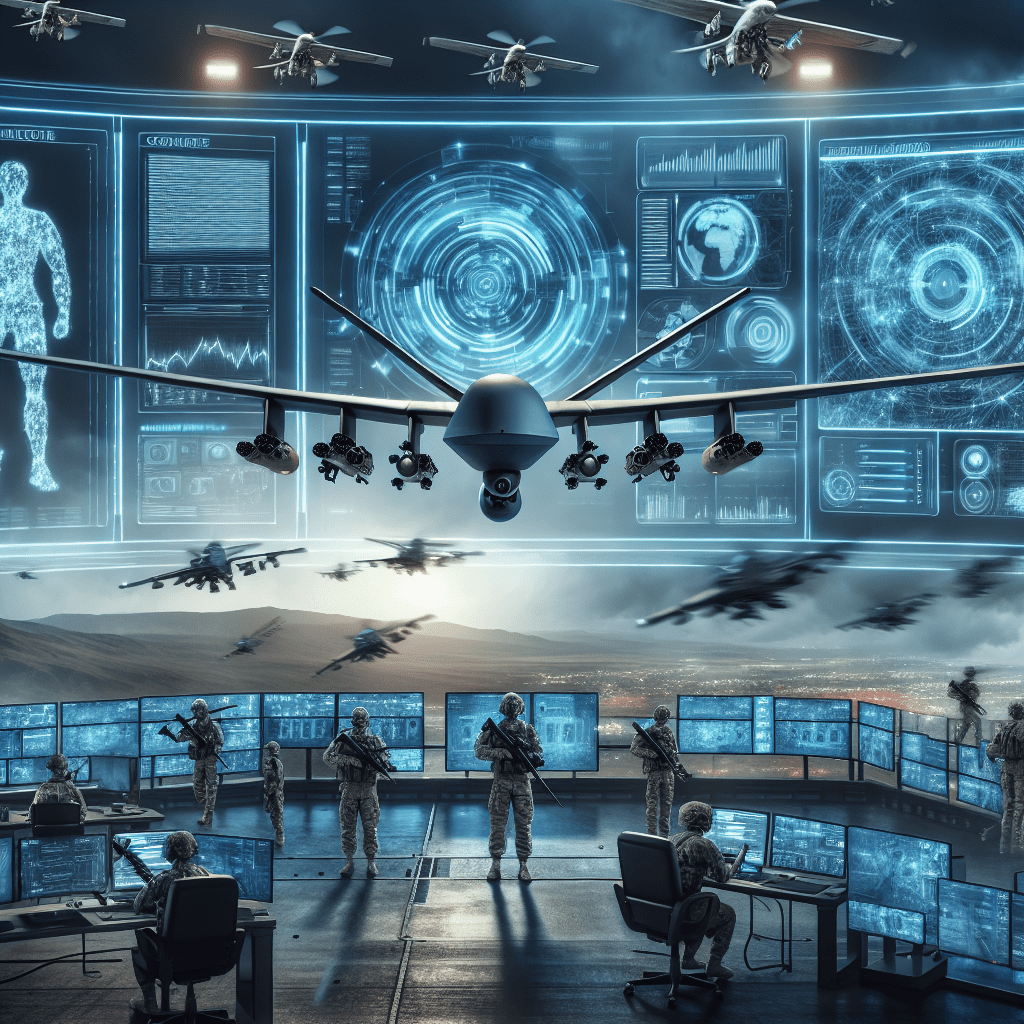

Willkommen in einer neuen Ära der Kriegsführung, in der künstliche Intelligenz (KI) eine immer dominierendere Rolle spielt. Ganz recht, du hast richtig gelesen. Künstliche Intelligenz rückt immer mehr ins Zentrum von Strategie und Taktik militärischer Auseinandersetzungen. In diesem Zusammenhang stellen sich Fragen nach ethischer Zulässigkeit, rechtlicher Regulierung und potenziellen Auswirkungen auf globaler Ebene.

Wir werden also einen Blick darauf werfen, wie die Entwicklung und Anwendung künstlicher Intelligenz in Militärtechnologien voranschreitet und welche Vorteile, aber auch Risiken, automatisierte Waffensysteme mit sich bringen. Ebenso werfen wir einen Blick auf ethische und rechtliche Fragen, die durch automatisierte Kriegsführung aufgeworfen werden.

Gleichzeitig soll auch die Rolle der KI in militärischen Entscheidungsprozessen und der Cyber-Kriegsführung beleuchtet werden, zwei Bereiche, die oft unterschätzt werden. Darüber hinaus diskutieren wir die Bedeutung der KI in der asymmetrischen Kriegsführung und werfen einen Blick auf völkerrechtliche Perspektiven in Kriegsszenarien.

Zum Abschluss schauen wir uns an, welche Trends die Künstliche Intelligenz für zukünftige Kriegsführung setzt. Das alles und mehr erwartet dich in unserer umfassenden Diskussion von „Künstliche Intelligenz in der Kriegsführung: Eine neue Ära des Konflikts“. Mach dich bereit, in eine Zukunft zu blicken, die schon lange Realität geworden ist.

1 Entwicklung und Anwendung künstlicher Intelligenz in Militärtechnologien

Eine beachtliche Entwicklung in den Militärtechnologien der heutigen Zeit beinhaltet die Anwendung künstlicher Intelligenz (KI). Mit der rasanten Fortschreitung der KI-Forschung und -Entwicklung haben Militärs weltweit begonnen, die Möglichkeiten dieser Technologie zu erkunden und zu nutzen.

Die Anwendung von KI in der Kriegsführung ist vielfältig. Einer der Hauptbereiche, in denen KI eingesetzt wird, ist die Aufklärung und Überwachung. Mit dem Einsatz von KI können riesige Mengen an Daten gesammelt, analysiert und interpretiert werden. Das ermöglicht eine bessere Vorhersage von feindlichen Bewegungen und trägt zur Optimierung von Entscheidungsprozessen bei.

KI wird auch bei der Entwicklung von autonomen Waffensystemen eingesetzt. Diese Systeme können ihre Ziele selbstständig identifizieren, verfolgen und zerstören, ohne menschliches Zutun. Das bringt einerseits den Vorteil einer effizienteren Kriegsführung, birgt aber auch ethische und rechtliche Herausforderungen, die noch bewältigt werden müssen.

Außerdem wird KI zunehmend im Bereich der Cyber-Kriegsführung eingesetzt. Hier kann KI helfen, komplexe Angriffe zu erkennen, abzuwehren und durchzuführen. Sie kann auch dazu beitragen, aufkommende Bedrohungen frühzeitig zu erkennen und Gegenmaßnahmen einzuleiten.

Während es noch viele Unsicherheiten und Herausforderungen gibt, kann dies nicht darüber hinwegtäuschen, dass die Anwendung von KI in den Militärtechnologien die Art und Weise, wie Kriege geführt werden, grundlegend verändert. Daher ist es entscheidend, weiterhin die Entwicklung und Anwendung in diesem Sektor kritisch zu beobachten und zu bewerten.

2 Automatisierte Waffensysteme: Vorteile und Risiken

Eines der Hauptmerkmale der modernen Kriegsführung ist die zunehmende Automatisierung von Waffen und Kampfsystemen durch den Einsatz von künstlicher Intelligenz. Dieser Ansatz birgt sowohl Vorteile als auch Risiken.

Beginnen wir mit den Vorteilen. Automatisierte Waffensysteme können Aufgaben übernehmen, die sonst von einem Menschen wahrgenommen werden müssten – oft unter extrem schwierigen oder gefährlichen Bedingungen. Das bedeutet, dass Soldaten weniger gefährdet sind und die menschlichen Kosten von Kriegen und bewaffneten Konflikten insgesamt verringert werden könnten. Automatisierte Waffensysteme können auch effizienter sein als menschliche Soldaten, da sie nicht müde oder emotional gestresst werden und immer genau nach den Anweisungen handeln, die ihnen gegeben wurden.

Ein weiterer Vorteil ist, dass automatisierte Waffensysteme schneller reagieren können als Menschen. In einem modernen Kampfszenario, in dem Sekundenbruchteile den Unterschied ausmachen können, kann dies einen wichtigen Vorteil darstellen.

Allerdings gibt es auch ernsthafte Risiken und Bedenken. Zum Beispiel die Tatsache, dass solche Systeme in der Lage sind, Ziele autonom zu identifizieren und anzugreifen, wirft gravierende ethische Fragen auf. Sollten Maschinen wirklich die Macht haben, über Leben und Tod zu entscheiden?

Darüber hinaus besteht die Gefahr, dass die automatischen Systeme gehackt werden und in die falschen Hände geraten. Denk daran, dass eine solche Technologie letztlich nur so gut ist wie ihre Programmierung und Sicherheitsmaßnahmen. Ein feindlicher Staat oder eine Terrorgruppe, die in der Lage ist, ein automatisiertes Waffensystem zu hacken, könnte es gegen uns einsetzen.

Es gibt auch Bedenken hinsichtlich einer möglichen „Automatisierungsspirale“, bei der Staaten in einen Wettlauf geraten, um die fortschrittlichsten automatisierten Waffen zu entwickeln, um mit ihren Konkurrenten Schritt zu halten. Dies könnte die Schwelle für den Einsatz von Gewalt senken und die Wahrscheinlichkeit von Konflikten erhöhen.

Ethik und Rechtsfragen automatisierter Kriegsführung

Automatisierte Kriegsführung mit der Hilfe von künstlicher Intelligenz wirft eine Reihe von ethischen und rechtlichen Fragen auf. Die wichtigsten von ihnen sind die Verantwortlichkeit, der Schutz der Zivilbevölkerung und das Prinzip der Notwendigkeit und Verhältnismäßigkeit im bewaffneten Konflikt.

Was die Verantwortlichkeit angeht, so fragst du dich sicherlich, wer verantwortlich gemacht werden sollte, wenn ein autonomes Waffensystem einen Fehler macht oder gegen das Völkerrecht verstößt. Ist es der Programmierer, der Hersteller oder der Bediener, oder sogar das Land, das das System einsetzt? Die Antwort darauf ist nicht eindeutig und bleibt eine der größten Herausforderungen in dieser Debatte.

Dann gibt es noch den Schutz der Zivilbevölkerung. Du magst denken, dass autonome Waffensysteme präziser sind und daher die Zahl der zivilen Opfer reduzieren könnten. Allerdings gibt es Bedenken, dass diese Systeme nicht in der Lage sein könnten, zwischen Kämpfern und Zivilisten zu unterscheiden, vor allem in komplexen urbanen Umgebungen.

Schließlich stellt sich die Frage der Notwendigkeit und Verhältnismäßigkeit. Wenn ein autonomes Waffensystem in der Lage ist, einen Angriff mit weniger Risiken und Kosten durchzuführen, könnte es verlockend sein, es in Situationen einzusetzen, in denen der menschliche Einsatz nicht gerechtfertigt wäre. Aber in diesem Fall könnte das Prinzip der Notwendigkeit, das heißt, nur Gewalt anzuwenden, wenn es absolut notwendig ist, verletzt werden.

All diese Fragen zeigen, dass die rechtlichen und ethischen Aspekte automatisierter Kriegsführung noch weitgehend ungelöst sind und dringend klare Regulierungen und Leitlinien benötigen.

4 Künstliche Intelligenz in militärischen Entscheidungsprozessen

Im militärischen Bereich kann die Künstliche Intelligenz (KI) eine wesentliche Rolle in den Entscheidungsprozessen spielen. Von der Analyse komplexer Datenmengen bis hin zur Vorhersage möglicher Szenarien, KI hat das Potenzial, die Fähigkeiten des Militärs wesentlich zu verbessern.

Im Bereich der Informationsverarbeitung kann KI verwendet werden, um Muster in großen Datenmengen zu identifizieren, die für das menschliche Auge schwer zu erkennen wären. Das kann von der Identifizierung potenzieller Bedrohungen bis zur Vorhersage von feindlichen Bewegungen reichen. Es hilft dabei strategische Entscheidungen schneller und effizienter zu treffen.

Darüber hinaus bietet KI eine Möglichkeit, Risiken zu minimieren. Mit ihr können Soldaten in Trainingssimulationen eine Vielzahl von Szenarien durchspielen, ohne dass dabei Menschenleben aufs Spiel gesetzt werden müssen. So können Risiken besser abgeschätzt und Entscheidungen sicherer getroffen werden.

Dennoch gibt es Herausforderungen und Risiken in der Anwendung von KI in militärischen Entscheidungsprozessen. Einerseits gibt es technische Hürden wie die Qualität und Integrität der Daten, auf denen die KI basiert. Andererseits gibt es auch ethische und rechtliche Fragen zu berücksichtigen: Wer trägt die Verantwortung, wenn eine von KI unterstützte Entscheidung zu einem schädlichen Vorfall führt? Und wann sollte die Entscheidung letztendlich doch bei einem Menschen liegen?

Mit diesen Fragen wird sich jede militärische Einheit, die KI einsetzen möchte, auseinandersetzen müssen. Aber es ist klar, dass die Nutzung der Künstlichen Intelligenz in militärischen Entscheidungsprozessen das Potential hat, sowohl die Effizienz als auch die Sicherheit im militärischen Bereich erheblich zu verbessern.

5 Cyber-Kriegsführung und künstliche Intelligenz: Eine unterschätzte Gefahr

In der heutigen Welt hast du wahrscheinlich den Begriff „Cyber-Kriegsführung“ gehört. Dies ist ein Aspekt der Kriegsführung, der das Internet und die digitale Technologie nutzt, um gegnerische Netzwerke anzugreifen und zu infiltrieren. Künstliche Intelligenz (KI) spielt in diesem Szenario eine immer wichtigere Rolle und doch wird sie oft als Bedrohung unterschätzt.

Künstliche Intelligenz kann enorm effektiv in der Cyber-Kriegsführung eingesetzt werden. Sie kann zur Erkennung und Abwehr von Cyber-Angriffen genutzt werden, zur Durchführung von Angriffen oder sogar zur Automatisierung dieses Prozesses. KI-Systeme können enorme Mengen an Daten verarbeiten und in Sekundenschnelle auf Bedrohungen reagieren, viel schneller als es Menschen könnten.

Aber während KI im Kampf gegen Cyber-Angriffe äußerst nützlich sein kann, birgt sie auch erhebliche Risiken. Ein Hauptanliegen ist, dass KI-Systeme dazu genutzt werden könnten, groß angelegte Cyber-Angriffe zu automatisieren. Diese KI-gesteuerten Angriffe könnten potenziell verheerend sein und nicht nur militärische, sondern auch zivile Infrastrukturen disruptiv beeinflussen.

Zusätzlich dazu können KI-Systeme gehackt oder manipuliert werden, um gegnerische Ziele anzugreifen oder um Fehlinformationen zu verbreiten. Dies könnte dazu führen, dass Konflikte eskalieren oder dass ungenaue Informationen die öffentliche Meinung beeinflussen und soziale Spannungen verschärfen.

Es ist also offensichtlich, dass KI und Cyber-Kriegsführung Hand in Hand gehen und ihr Einsatz sorgfältig überwacht und reguliert werden sollte. Ihre Rolle und ihr Potenzial in der modernen Kriegsführung ist eine Realität, die wir nicht ignorieren sollten, sondern stattdessen aktiv haushalten müssen, um ihre Risiken zu kontrollieren und ihren Nutzen zu maximieren.

6 Künstliche Intelligenz und asymmetrische Kriegsführung

Asymmetrische Kriegsführung bezieht sich auf Szenarien, in denen die kämpfenden Parteien nicht die gleiche technische, wirtschaftliche oder militärische Stärke haben. Sie kann auch die Anwendung von Taktiken beinhalten, die übliche militärische Strategien und Praktiken untergraben oder umgehen. Künstliche Intelligenz (KI) hat das Potenzial, solche ungleichen militärischen Konflikte neu zu gestalten.

Insbesondere kleinere oder technisch rückständigere Armeen könnten KI nutzen, um gezielt Informationslücken zu füllen, die sie in herkömmlichen Militärmaßnahmen haben könnten. Beispielsweise könnten Drohnen, die mit KI ausgestattet sind, dazu genutzt werden, um effektivere Aufklärung zu betreiben oder um gezielte Angriffe durchzuführen – und das ohne das Risiko menschlicher Opfer auf ihrer Seite.

Aber die Möglichkeit der Verwendung von KI in asymmetrischen Kriegen birgt auch Gefahren. Die Nutzung von KI könnte das Konfliktgeschehen verschärfen, indem sie Bewaffnung und Gewaltanwendung leichter, anonymer und möglicherweise unkontrollierbarer macht. Ein weiteres Risiko besteht darin, dass die Just-in-Time-Produktion von präzisen Waffen und das maschinelle Lernen dazu führen könnten, dass Kriege ausgefochten werden, ohne dass die menschliche Kontrolle oder Rechenschaftspflicht in Echtzeit gewährleistet ist.

Letztendlich wird die Rolle der KI in der asymmetrischen Kriegsführung von der Art der verwendeten Technologien, den ethischen und rechtlichen Normen, die ihre Anwendung regeln, und den strategischen Überlegungen, die ihre Entwicklung und Verwendung leiten, bestimmt. Es liegt an dir, aufgeklärt und informiert zu bleiben, um dich an diesen wichtigen Diskussionen beteiligen zu können.

7 Völkerrechtliche Perspektiven auf künstliche Intelligenz in Kriegsszenarien

Während wir die Rolle der künstlichen Intelligenz in Kriegssituationen betrachten, ist es unerlässlich, einen Blick auf die völkerrechtlichen Perspektiven zu werfen. Es stellt sich die Frage, inwieweit künstliche Intelligenz und automatisierte Waffensysteme mit bestehenden Rechtsnormen und Verträgen vereinbar sind.

Erstens ist das humanitäre Völkerrecht relevant, das verschiedene Prinzipien für den Einsatz von Gewalt in kriegerischen Konflikten festlegt. Dazu gehört zum Beispiel das Unterscheidungsvermögen zwischen Zivilisten und Kämpfern, das bei autonomen Waffensystemen durchaus ein Problem darstellen kann.

Zweitens spielt das internationale Menschenrecht eine Rolle. Hier geht es vor allem um das Recht auf Leben und persönliche Sicherheit, das in Kriegsszenarien stark eingeschränkt sein kann.

Trotz aller Bedenken, sollte man auch die möglichen völkerrechtlichen Vorteile von künstlicher Intelligenz in Kriegssituationen im Auge behalten. Es könnte zum Beispiel möglich sein, dass durch ihren Einsatz weniger Zivilisten in Mitleidenschaft gezogen werden, da Zielgenauigkeit und strategische Effizienz verbessert werden könnten.

Aber alle diese Aspekte sind noch Gegenstand von Diskussionen und Debatten, sowohl unter Juristen als auch unter politischen Entscheidungsträgern und Militärstrategen. Künstliche Intelligenz bringt definitiv neue Herausforderungen mit sich, aber sie kann auch neue Lösungsansätze für alte Probleme bieten.

8 Künstliche Intelligenz und zukünftige Kriegstrends

Der technologische Fortschritt in der Künstlichen Intelligenz revolutioniert die Welt der Marktmächte. Dies spiegelt sich direkt in der Vorbereitung und Durchführung moderner Kriege wider. Zukünftige Kriegstrends werden wahrscheinlich einen vermehrten Einsatz von KI-Technologien umfassen. Deutliche Schwerpunkte werden dabei wahrscheinlich auf automatisierten Waffensystemen und auf einer KI-gestützten Kriegsführung im Cyberspace liegen.

Automatisierte Waffensysteme, wie Drohnen, könnten weitgehend autonom agieren, um Feinde zu erkennen, zu verfolgen und zu bekämpfen. Dies kann nicht nur die Wirksamkeit von Militäroperationen verbessern, sondern auch das Risiko menschlicher Verluste verringern. Jedoch gibt es ernsthafte ethische Fragen bezüglich KI-gesteuerten Waffen und es besteht die Gefahr, dass solche Systeme in die falschen Hände geraten könnten.

In der Cyber-Kriegsführung besteht eine zentrale Anwendung von KI darin, Angriffe auf kritische Infrastrukturen oder Spionagen zu erkennen, frühzeitig zu warnen und abzuwehren. Dennoch besteht die Gefahr, dass entstehende asymmetrische Kriegstechniken durch einzelne Akteure oder kleine Gruppen die traditionelle Kriegsführung herausfordern und destabilisieren könnten.

Von einem rechtlichen Standpunkt aus, sind internationale Gesetze und Verordnungen noch nicht ausreichend definiert, um die neuen Herausforderungen, die die KI in der Kriegsführung stellt, zu behandeln. Nur eine Mischung aus Gesetzgebung, Normen und Kontrollen kann das volle Potential von KI in der Kriegsführung zum Vorteil der Menschheit realisieren und gleichzeitig Missbrauch verhindern.

Die Künstliche Intelligenz wird die Kriegsführung zweifellos in einer Weise transformieren, die wir uns heute schwer vorstellen können. In der nahen Zukunft könnten Kämpfe weit weniger auf physischen Schlachtfeldern und vermehrt im Bereich der Technologie und im Cyberspace ausgetragen werden.